Bu yazıda ele alınanlar: KVKK’nın Şubat 2026 tarihli “İş Yerlerinde Üretken Yapay Zeka Araçlarının Kullanımı” rehberi kapsamında Shadow AI’ın hukuki tanımı, veri sorumlusu yükümlülükleri, somut risk senaryoları ve CISO’ların hayata geçirmesi gereken kontrol mekanizmaları.

Çalışanlarınız bugün ofiste ChatGPT’ye müşteri toplantı notlarını yapıştırıyor. Bir başkası sözleşme taslağını Gemini’ye gönderiyor. Bir diğeri ise şirket içi maaş verilerini içeren tabloyu bir yapay zeka aracına yükleyerek formüllerin düzeltilmesini istiyor. Bunların hiçbiri BT’nin ya da bilgi güvenliği biriminizin radarında görünmüyor.

Bu tablo artık spekülatif bir gelecek senaryosu değil. Kişisel Verileri Koruma Kurumu (KVKK), Şubat 2026’da yayımladığı rehberle bu olguyu resmen adlandırdı: Gölge Yapay Zeka (Shadow AI). Ve sorumluluk, çalışanın değil, veri sorumlusunun — yani sizin kurumunuzun üzerinde.

KVKK Gölge Yapay Zekayı Nasıl Tanımlıyor?

KVKK’nın Şubat 2026 tarihli rehberi, Shadow AI kavramını Türk hukuki terminolojisine net bir biçimde soktu. Rehbere göre Gölge Yapay Zeka; kurum veya kuruluşun bilgisi, onayı veya kurumsal kontrolü dışında çalışanlar tarafından iş süreçlerinde üretken yapay zeka araçlarının kullanılması durumunu ifade etmektedir.

Bu tanımın kritik sonucu şudur: Çalışanın eylemi “kurumun bilgisi dışında” gerçekleşmiş olsa bile, KVKK’nın 12. maddesi uyarınca veri güvenliğini sağlama yükümlülüğü veri sorumlusu sıfatını taşıyan kuruma aittir. Çalışanın gizli faaliyeti, kurumun yasal sorumluluğunu ortadan kaldırmaz.

Shadow IT’den Farkı Nedir? Neden Daha Riskli?

Gölge BT (Shadow IT) ile Gölge YZ (Shadow AI) arasında yapısal bir benzerlik var: her ikisi de kurumsal denetimin dışında işlemektedir. Ancak Shadow AI, birkaç temel özelliği nedeniyle çok daha yüksek risk taşır:

Veri işleme boyutu: Klasik Shadow IT’de çalışan yetkisiz bir araç kullanır; Shadow AI’da ise kuruma ait kişisel veriler üçüncü taraf yapay zeka sistemlerinin eğitim veya işleme altyapısına girmekte, bu sürecin ne şekilde işlendiği kurumca bilinmemektedir.

Yurt dışı aktarım riski: ChatGPT, Gemini, Claude gibi araçların sunucuları Türkiye’de değildir. KVKK’nın 9. maddesi kapsamında yurt dışı aktarım için açık rıza ya da yeterli güvence şartı aranır. Çalışanın bireysel kullanımı bu güvenceyi sağlamaz.

Görünmezlik sorunu: Hangi aracın, hangi veriyle, hangi amaçla kullanıldığı kurumsal log sistemlerinde iz bırakmaz. Bir ihlal sonrası olay müdahalesinde bu görünmezlik delil toplanamaz noktaya götürür.

Ölçek ve hız: Bir çalışan birkaç saniyede binlerce satır kişisel veri içeren tabloyu bir YZ aracına yükleyebilir. Shadow IT’de bu ölçekte anlık veri hareketi çok daha sınırlıydı.

CISO’nun Radarında Olması Gereken Risk Senaryoları

Aşağıdaki senaryolar soyut değildir. KVKK’nın rehberinde doğrudan atıfta bulunduğu gerçek kullanım örüntüleridir:

Senaryo 1 — İK Verisi

Bir İK uzmanı, performans değerlendirme formlarını (çalışan adları, maaş bilgileri, disiplin notları dahil) ChatGPT’ye yapıştırarak rapor taslağı hazırlatıyor. Bu veriler artık ABD sunucularında işlendi ve KVKK kapsamında yurt dışı aktarım gerçekleşti — herhangi bir güvence mekanizması olmaksızın.

Senaryo 2 — Müşteri Verisi

Satış ekibinden bir çalışan, CRM’den aldığı müşteri listesini (ad, telefon, e-posta, satın alma geçmişi) bir yapay zeka aracına yükleyerek segmentasyon analizi yaptırıyor. Müşterilerden bu işlem için ne aydınlatma yapıldı ne de rıza alındı.

Senaryo 3 — Gizli Kurumsal Bilgi

Bir hukuk asistanı, henüz imzalanmamış sözleşme taslağını (taraflar, ticari koşullar, gizlilik maddeleri dahil) bir YZ aracına göndererek dil kontrolü yaptırıyor. Ticari sır niteliğindeki bu belge artık kurumun kontrolü dışına çıktı.

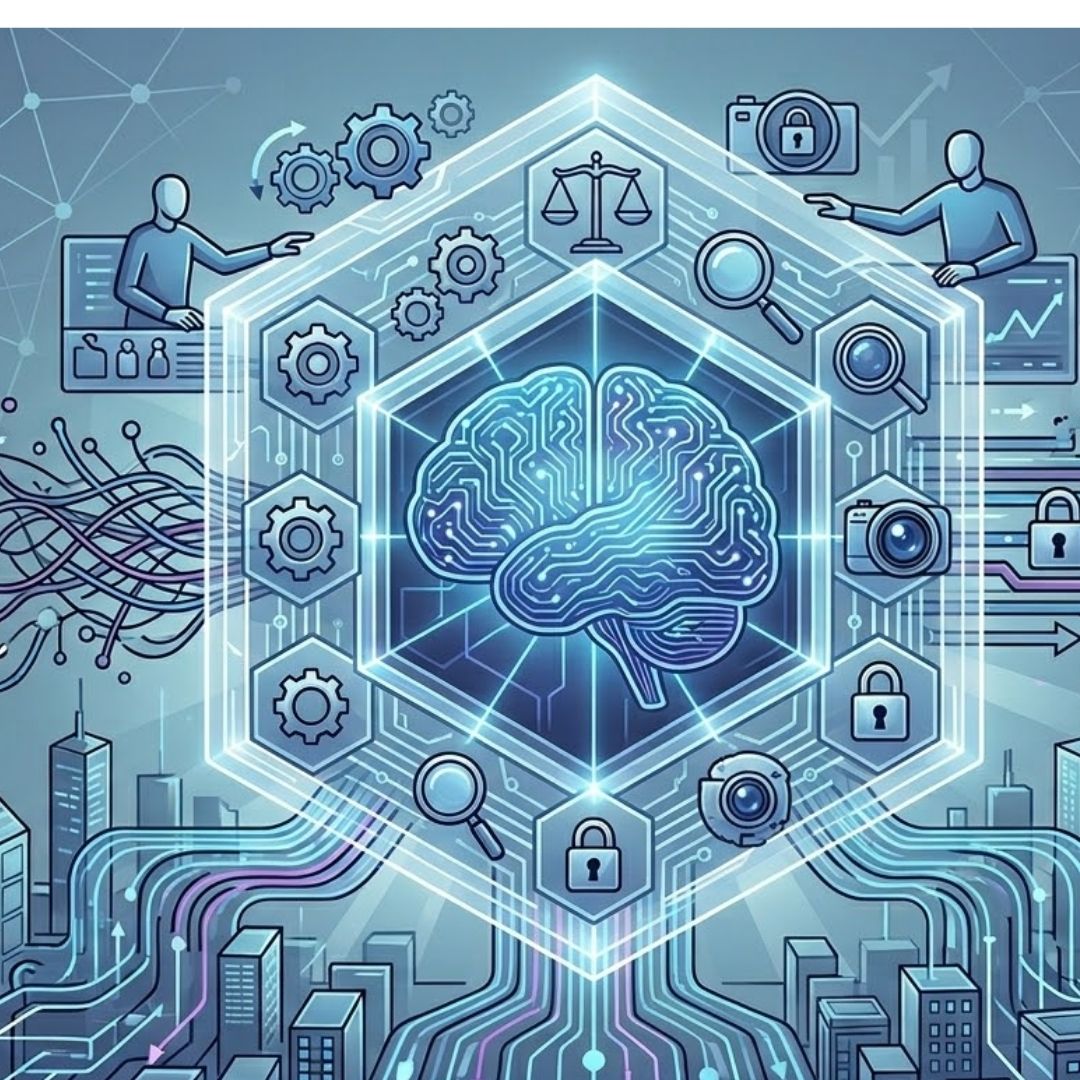

KVKK Rehberi Kurumlardan Ne Bekliyor?

KVKK’nın Şubat 2026 rehberi, kurumların alması gereken önlemleri üç eksen etrafında topluyor. Bunlar bir “tavsiye listesi” değil; denetim süreçlerinde referans alınacak çerçeve niteliğindedir.

1. Kurumsal Politika ve Yönetişim Altyapısı

Hangi yapay zeka araçlarının, hangi koşullarda ve hangi veri sınıflandırma seviyesiyle kullanılabileceğini tanımlayan yazılı bir YZ kullanım politikası zorunludur. Bu politika; onaylı araç envanterini, yasaklı veri kategorilerini (özel nitelikli kişisel veriler, ticari sırlar) ve aykırılık halinde uygulanacak yaptırımları kapsamalıdır.

ISO 42001 çerçevesiyle uyumlu bir yapay zeka yönetim sistemi kurmak, bu politikanın sürdürülebilir ve denetlenebilir hale gelmesini sağlar. Politikanın var olması yeterli değildir; işletildiğinin kanıtlanabilir olması da gerekir.

2. Teknik Kontrol Mekanizmaları

Rehber, teknik önlemler konusunda kurumları aktif bir pozisyona çağırıyor. Uygulamaya alınması değerlendirilebilecek kontroller şunlardır:

Kurumsal ağ üzerinde onaylanmamış YZ araçlarına erişimin DNS veya proxy katmanında kısıtlanması

DLP (Data Loss Prevention) çözümlerinin yapay zeka alan adlarını kapsayacak şekilde genişletilmesi

SIEM/log yönetim sistemlerinde yapay zeka araç trafiğine yönelik kural setleri oluşturulması

Kurumsal onaylı YZ platformları için SSO ve kimlik doğrulama entegrasyonu sağlanması

3. Farkındalık ve Eğitim Yükümlülüğü

Rehber, çalışan farkındalığını teknik kontrollerin tamamlayıcısı olarak konumlandırıyor. Çalışanların “yanlış yaptım” değil, “neyin yanlış olduğunu bilmiyordum” savunması, KVKK ihlali halinde kurumu korumaz. Dolayısıyla YZ araçlarının hangi verilerle kullanılamayacağı ve KVKK yükümlülükleri konusunda belgelenmiş ve periyodik eğitim programları yürütülmelidir.

Veri Sorumlusu Olarak Hukuki Maruziyetinizi Değerlendirin

KVKK’nın 12. maddesi, veri sorumlularından kişisel verilerin hukuka aykırı işlenmesini önlemek amacıyla uygun güvenlik düzeyini temin edecek her türlü teknik ve idari tedbiri almalarını zorunlu kılar. Shadow AI kaynaklı bir ihlal senaryosunda “bundan haberdar değildik” savunması bu yükümlülüğü karşılamaz; aksine gerekli önlemlerin alınmadığının göstergesi olarak değerlendirilebilir.

Somut risk: Çalışanınızın kişisel bir hesapla üçüncü taraf bir YZ aracına yüklediği müşteri verisi, KVKK kapsamında bildirim yükümlülüğü doğuran bir kişisel veri ihlali sayılabilir ve Kurul’a 72 saat içinde bildirim yapılması gerekebilir.

CISO Kontrol Listesi — Shadow AI

[ ] Kurumunuzda onaylı ve yasaklı YZ araçlarını tanımlayan yazılı bir politika var mı?

[ ] DLP çözümünüz yapay zeka alan adlarını kapsıyor mu?

[ ] Çalışanlarınız hangi veriyi YZ araçlarına giremeyeceğini biliyor mu? Eğitim belgelenmiş mi?

[ ] Üçüncü taraf YZ araçlarıyla imzalanmış Veri İşleme Sözleşmeleri (VİS) mevcut mu?

[ ] KVKK’nın Şubat 2026 rehberi kapsamında bir boşluk analizi yapıldı mı?

[ ] Shadow AI kaynaklı bir veri ihlali senaryosunda olay müdahale planınız devreye girebilecek durumda mı?

Sonuç: Politika Boşluğu, Hukuki Maruziyet Anlamına Geliyor

KVKK’nın Şubat 2026 rehberi, yapay zekanın iş yerlerinde nasıl kullanılacağını düzenleme yolundaki ilk ciddi adımdır. Türkiye’de AB Yapay Zeka Yasası’na paralel düzenlemelerin hızlandığı bu süreçte Shadow AI, bugün için bir uyum riski; yakın gelecek için ise potansiyel bir idari yaptırım konusu haline geliyor.

Bilgi güvenliği yöneticileri için bu yazının ana mesajı nettir: Çalışanlarınız yapay zeka kullanıyor. Bunu bilseniz de bilmeseniz de. Soru, bu kullanımın kontrollü ve belgelenmiş bir çerçevede mi yoksa kurumsal görünmezlik içinde mi sürdüğüdür.

Kurumunuzun Shadow AI olgunluğunu değerlendirmek ister misiniz?

Secure Fors olarak KVKK uyum danışmanlığı, YZ yönetişim politikası geliştirme ve ISO 42001 hazırlık süreçlerinde kurumunuza destek veriyoruz.

Bize Ulaşın