Secure Fors — Yapay Zeka Yönetişim Serisi

Kurumlarda Güvenli

Yapay Zeka Kullanımı:

Riskler, Politika ve Yönetişim

Çalışanlarınız yapay zeka kullanıyor. Belki biliyorsunuz, belki bilmiyorsunuz. Asıl soru şu: Kurumunuz bu kullanımı yönetiyor mu, yoksa yönetilmesini mi bekliyor?

%54

çalışan, kurum izni

olmasa da YZ kullanmaya

devam edeceğini söylüyor (BCG, 2025)

%485

kurumsal verinin dış YZ

araçlarına aktarımında artış

(2023-2024) (Cyberhaven)

%93

üst düzey yönetici,

onaylanmamış YZ aracı

kullanıyor (McKinsey, 2025)

Bu Yazıda

- Yapay Zeka Kurumunuza Girdi — Siz Hazır mısınız?

- Shadow AI: Görünmez Tehdit

- Kurumsal YZ Kullanımının 5 Temel Güvenlik Riski

- Yasal Çerçeve: KVKK, ISO 42001 ve EU AI Act

- Kurumsal Yapay Zeka Politikası Nasıl Kurulur? Trafik Işığı Modeli

- Secure Fors ile Yapay Zeka Yönetişimi: Eğitim ve Danışmanlık

- Sık Sorulan Sorular

1. Yapay Zeka Kurumunuza Girdi — Siz Hazır mısınız?

Üretken yapay zeka araçları — ChatGPT, Gemini, Copilot, Claude ve bunların onlarcası — artık kurumların kapısında değil, içinde. Muhasebe çalışanı e-posta taslağı yazdırıyor. Satış ekibi teklif oluşturuyor. Yazılım geliştirici hata ayıklatıyor. İnsan kaynakları iş ilanı hazırlıyor. Hukuk danışmanı sözleşme maddelerini özetletiyor.

Bu kullanımların büyük çoğunluğu kurumun bilgisi dışında gerçekleşiyor. Çalışan kurumsal verileri, müşteri bilgilerini, stratejik planları ya da kaynak kodlarını harici bir YZ sistemine giriyor — bunu bir güvenlik ihlali olarak değil, iş sürecini hızlandıran bir araç olarak görüyor.

Kurumlar için asıl tehlike artık yapay zekanın kullanılması değil; denetimsiz, politikasız ve güvensiz kullanılmasıdır. Yapay zekayı yasaklamak bir çözüm değil; çalışanlar yasaklara rağmen kullanmaya devam eder — bu sefer daha gizli. Çözüm, yapay zekayı sorumlu biçimde yönetmektir.

Gerçek Hayattan Senaryolar — Bu Kurumunuzda Oluyor Olabilir

Yeni işe alınan bir çalışan, aday özgeçmişlerini ve maaş bilgilerini ChatGPT’ye yükleyerek “analiz” ettirdi. Bu veriler artık Türkiye dışında bir sunucuda işleniyor.

Bir satış müdürü, henüz imzalanmamış büyük müşteri sözleşmesinin detaylarını YZ aracına girip “iyileştirme önerisi” istedi. Rakip bir firmada çalışan eski çalışan aynı aracı kullandığında bu bilgilere ulaşabilir mi? Belirsiz.

Bir geliştirici, üretim ortamındaki güvenlik açığını içeren kaynak kodunu Copilot’a yapıştırarak düzeltme istedi. Açık kaynak modeli bu kodu eğitim verisi olarak kullanabilir.

Bir muhasebe uzmanı, henüz kamuoyuyla paylaşılmamış üç aylık finansal sonuçları bir YZ aracına yükleyip “yönetici özeti” oluşturdu. Halka açık şirket için bu içerden bilgi (insider trading) riski doğurabilir.

2. Shadow AI: Görünmez Tehdit

Shadow AI (Gölge Yapay Zeka), kurumun resmi onayı veya BT denetimi olmadan çalışanların kendi inisiyatifleriyle kullandıkları yapay zeka araçlarının tümüdür. Kavram, siber güvenlik terminolojisindeki “Shadow IT”nin yapay zeka özelinde evrimidir.

Shadow AI çoğunlukla kötü niyetle başlamaz. Çalışan daha verimli olmak, görevi hızla tamamlamak, rekabetçi kalmak ister. Sorun niyet değil farkındalık ve politika eksikliğidir. Kurumsal verinin nereye gittiğini, nasıl işlendiğini, kimin erişebildiğini çalışan bilmez.

66

Kurumların ortalama kullandığı farklı GenAI uygulaması sayısı — bunların büyük çoğunluğu yüksek riskli kategoride

%80

KOBİ çalışanlarının yetkisiz YZ kullanımına dahil olma oranı — sorun yalnızca büyük kurumları değil herkesi etkiliyor

2030

Gartner tahmini: Kurumların %40’ından fazlası Shadow AI’dan kaynaklanan ciddi güvenlik veya uyum ihlali yaşayacak

Neden geleneksel Shadow IT’den daha tehlikeli? Klasik Shadow IT’de veriler şifreli konteynerlerde statik durur. Üretken YZ araçlarında ise girilen veriler modeli eğitmek, iyileştirmek için aktif olarak işlenir. Ücretsiz tüketici versiyonlarında bu veri kalıcı olarak sistemde kalabilir, başka kullanıcıların sorgularına dolaylı biçimde yansıyabilir. Veri bir kez girdikten sonra geri almak mümkün değildir.

3. Kurumsal YZ Kullanımının 5 Temel Güvenlik Riski

Yapay zekanın kurumsal kullanımı beş farklı risk boyutu taşır. Her biri bağımsız olarak da yıkıcı olabilir; bir arada gerçekleştiğinde ise telafi edilemez zararlar doğurabilir:

R1

Veri Sızıntısı ve Kişisel Veri İhlali

Çalışan harici bir YZ sistemine müşteri adı, T.C. kimlik numarası, sağlık verisi veya finansal bilgi girdiğinde bu veri Türkiye dışındaki sunuculara aktarılır. KVKK Madde 9 kapsamında yurt dışına veri aktarımı için yeterli güvencenin bulunması zorunludur. Çoğu ücretsiz YZ servisi bu güvenceyi karşılamaz. İhlal gerçekleştiğinde Kurul’a 72 saat içinde bildirim yükümlülüğü doğar.

R2

Ticari Sır ve Fikri Mülkiyet Kaybı

Henüz açıklanmamış ürün planları, fiyatlandırma stratejileri, patent başvuruları, kaynak kodu veya müşteri listeleri halka açık YZ modeline girdiğinde bunların ticari sır niteliği ortadan kalkabilir. Modelin bu bilgileri başka sorgular için kullanma ihtimali kurum için telafisi imkânsız bir rekabet hasarı yaratır.

R3

Prompt Injection ve Model Manipülasyonu

Prompt injection saldırısında, zararlı aktör YZ sistemine özel talimatlar gömerek kurumun kullandığı YZ aracını ele geçirebilir ya da çalışandan gizli bilgi sızdırabilir. Kurumsal YZ entegrasyonlarında bu risk özellikle ciddidir: Saldırgan sistemin çıktısını manipüle ederek kurumu yanlış kararlar almaya yönlendirebilir.

R4

Halüsinasyon ve Yanlış Bilgiye Dayalı Karar

Üretken YZ modelleri gerçek olmayan ama gerçekmiş gibi sunulan bilgi üretebilir — buna “halüsinasyon” denir. Hukuki belgede yanlış içtihat, finansal raporda yanlış rakam, güvenlik değerlendirmesinde yanlış bulgu: YZ çıktısının doğrulanmadan kullanılması kurumsal kararları tehlikeli biçimde yanıltabilir. Bu risk hem itibar hem de hukuki sorumluluk boyutu taşır.

R5

Tedarikçi Bağımlılığı ve Güven Zinciri Riski

Kurumsal süreçlere entegre edilen YZ hizmetleri giderek kritik birer bağımlılık noktasına dönüşür. Hizmet sağlayıcının politika değişikliği, fiyat artışı, güvenlik ihlali veya hizmet kesintisi kurumu doğrudan etkiler. Tedarikçi YZ modelinin güvenlik duruşu, KVKK uyumu ve veri işleme politikası değerlendirilmeden entegrasyon yapılmamalıdır. Bu aynı zamanda bir TPRM (üçüncü taraf risk yönetimi) meselesidir.

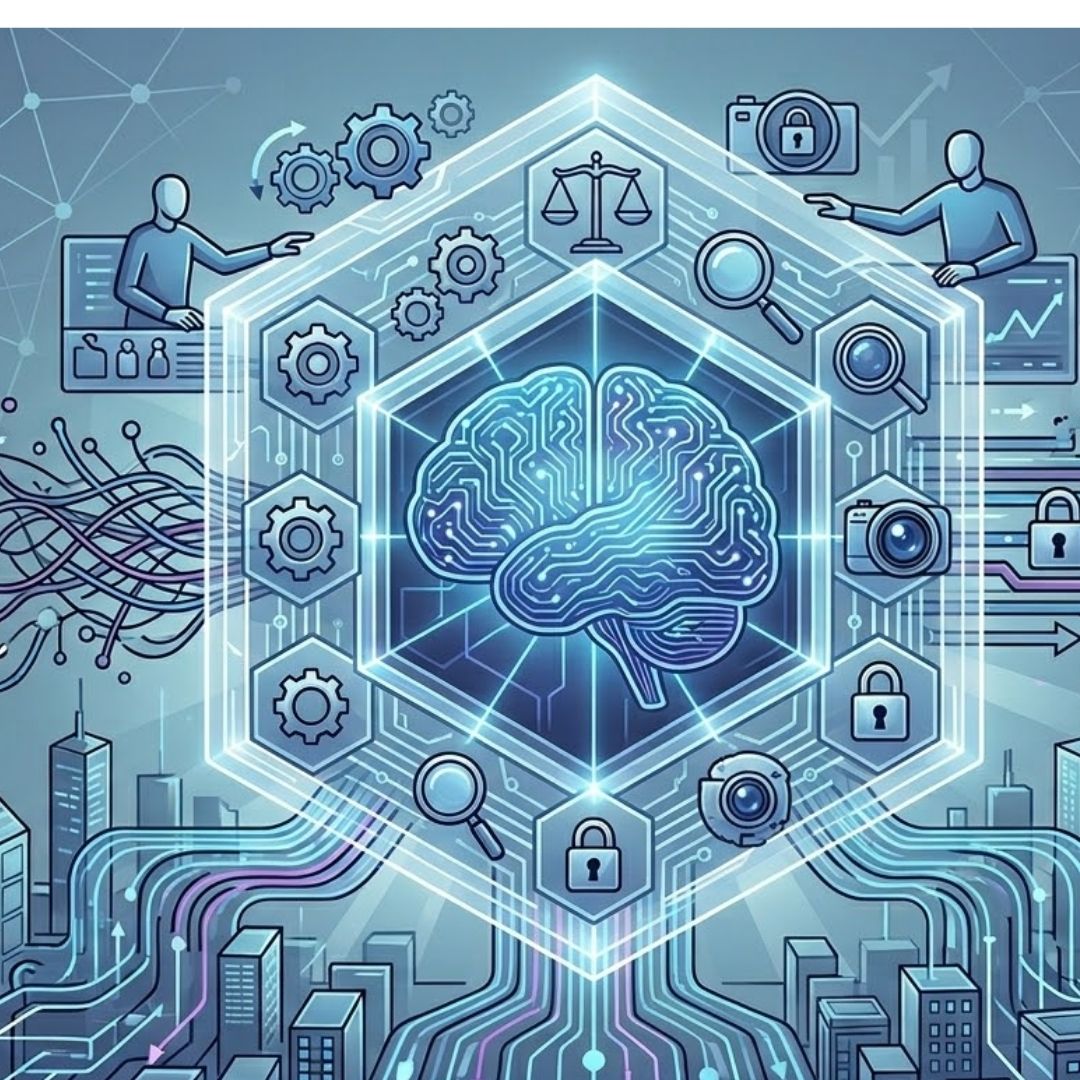

4. Yasal Çerçeve: KVKK, ISO 42001 ve EU AI Act

Türkiye’de yapay zekayı doğrudan düzenleyen bağımsız bir yasa henüz yürürlükte değildir. Ancak yapay zekanın kurumsal kullanımı birden fazla mevcut yasal ve standart çerçevesiyle kesişmekte; bu kesişim noktalarda ciddi yükümlülükler doğmaktadır:

KVKK (6698)

YürürlükteYZ ile kritik kesişim noktaları

- Madde 9: YZ sağlayıcısı yurt dışındaysa veri aktarımı güvencesi zorunlu

- Madde 11: Otomatik karar alma sistemlerine itiraz hakkı

- Madde 12: YZ araçlarına kişisel veri girişinde teknik tedbir yükümlülüğü

- KVKK Kurumu’nun Üretken YZ Rehberi (2024) — 15 Soruda çerçeve

ISO/IEC 42001:2023

Uluslararası StandartYapay Zeka Yönetim Sistemi

- YZ yönetişimi, risk yönetimi ve hesap verebilirlik çerçevesi

- ISO 27001 ile entegre yönetim sistemi yapısı

- YZ sistemlerinde şeffaflık, etik ve insan gözetimi

- Sertifikasyon ile kurumsal güven ve rekabet avantajı

EU AI Act

AB — Kademeli YürürlükAB ile iş yapan Türkiye kurumları için

- Risk temelli yaklaşım: Kabul edilemez / Yüksek / Sınırlı / Minimal risk sınıfları

- Yüksek riskli YZ sistemleri için kapsamlı uyum gereksinimleri

- AB pazarına hizmet veren Türk kurumlar doğrudan etkilenir

- Türkiye’nin yakın vadede benzer düzenleme yapması bekleniyor

Siber Güvenlik Kanunu (2025)

YürürlükteYZ ile kesişimi

- Kritik altyapıda YZ kullanımı kapsamına girebilir

- Siber güvenlik riskleri içeren YZ sistemleri denetim kapsamında

- YZ tabanlı güvenlik araçlarına özel düzenleme bekleniyor

- Tedarik zinciri güvenliği — YZ sağlayıcı değerlendirmesi

Türkiye’nin konumu: Yapay zekaya özgü bağımsız bir yasal düzenleme henüz yok. Ancak KVKK + Siber Güvenlik Kanunu + EU AI Act’e uyum zorunluluğu (AB ile iş yapan kurumlar) + ISO 42001 çerçevesi bir arada ele alındığında, “bekle gör” stratejisi artık ciddi risk taşımaktadır. Düzenleme geldiğinde uyumsuz kurumların geçiş süreci hem maliyetli hem zorlayıcı olacaktır.

5. Kurumsal Yapay Zeka Politikası Nasıl Kurulur?

İyi bir yapay zeka politikası “yapma” diyen bir yasaklar listesi değil, “nasıl güvenli yaparsın” diyen uygulanabilir bir kılavuzdur. Kapsamlı bir kurumsal YZ politikasının üç temel bileşeni vardır:

Veri Sınıflandırması — Trafik Işığı Modeli

Hangi veri hangi araçla kullanılabilir? Çalışanlara bu sorunun yanıtını net vermek politikanın kalbidir.

KIRMIZI — Kesinlikle Yasak

Bu veri türleri HİÇBİR koşulda halka açık YZ modellerine girilemez:

Kişisel veriler (T.C. no, sağlık, biyometrik)

Açıklanmamış finansal bilgiler

Kaynak kodu ve tescilli algoritmalar

Müşteri kimlik bilgileri ve sözleşmeler

Henüz ilan edilmemiş ürün planları

Güvenlik açıkları ve sızma testi raporları

SARI — Kontrollü / Anonimleştirilmiş

Sadece veri anonimleştirilmiş veya kurumsal kapalı devre Enterprise sistemde kullanılabilir:

Stratejik planlar (kimlik bilgisi olmadan)

İç raporlar ve analizler

Proje taslakları (hassas bilgi temizlenmiş)

Sektör araştırmaları

YEŞİL — Serbestçe Kullanılabilir

Onaylı araçlarla herhangi bir kısıtlama olmaksızın kullanılabilir:

Genel dil ve yazı desteği

Kamuya açık araştırma ve özetleme

Teknik kavram açıklaması

Formatlama ve taslak yazma (veri içermeden)

Onaylı Araç Envanteri

Kullanılabilecek araçların listesi, her aracın onay kapsamı (hangi veri sınıfı ile kullanılabilir) ve BT tarafından periyodik güncelleme mekanizması. Çalışan “neyin yasak olduğunu değil, neyin güvenli olduğunu” bilmeli.

İzleme ve Denetim Mekanizması

Kurumsal ağda hangi YZ servislerine trafik gittiğinin izlenmesi. DLP (Veri Kaybı Önleme) sistemlerinin YZ trafik kategorisini kapsayacak şekilde yapılandırılması. Anomali tespiti ve raporlama.

Üç Katmanlı Araç Sınıflandırması

Tüm kurum için açık araçlar (kısıtlı veri) / Belirli roller için onaylı araçlar (orta düzey veri) / Yalnızca BT ve güvenlik için araçlar (hassas veri). Bu sınıflandırma rol ve sorumlulukla örtüşmeli.

İhlal Bildirimi ve Yaptırım Süreci

Çalışanın yanlışlıkla hassas veri girdiğinde ne yapacağını bilmesi. İhlal bildirim mekanizması. Disiplin sürecinin politikada tanımlanması. Kasıtlı ihlaller için yaptırım kademeleri.

6. Secure Fors ile Yapay Zeka Yönetişimi: Eğitim ve Danışmanlık

Yapay zeka yönetişimi hem teknik hem de organizasyonel bir meseledir. Secure Fors olarak bu ihtiyacı iki hizmet koluyla karşılıyoruz: kurumun iç farkındalığını inşa eden eğitim ve yapısal çerçeveyi kuran danışmanlık.

▲

Hizmet 1

Kurumlarda Güvenli YZ Kullanımı Eğitimi

Çalışanları yapay zeka risklerinden korumanın en etkili yolu farkındalık ve net kılavuz ilkelerdir. Eğitimimiz teknik personelden genel çalışanlara kadar farklı düzeylerde yapılandırılmıştır.

Eğitim Modülleri

Üretken YZ nasıl çalışır ve verilerinize ne olur?

Shadow AI tehlikesi: gerçek vakalar

KVKK + yapay zeka kesişimi

Trafik Işığı Modeli — kuruma özgü uyarlama

Prompt injection ve model güvenliği temelleri

Kurumsal YZ politikası: ne bilmem gerekiyor?

Tüm çalışanlar için genel farkındalık versiyonu

BT / Güvenlik ekibi için teknik derinlikli versiyon

Yerinde veya uzaktan, kuruma özel uyarlama

Katılım belgesi (BGYS ve KVKK kanıtı)

◆

Hizmet 2

Yapay Zeka Yönetişim Danışmanlığı

Eğitim farkındalık yaratır; danışmanlık yapıyı kurar. Kurumunuz için kuruma özgü, sürdürülebilir ve denetlenebilir bir yapay zeka yönetişim çerçevesi oluşturuyoruz.

Danışmanlık Kapsamı

Mevcut durum analizi: Kurumda hangi YZ araçları kullanılıyor?

Yapay zeka risk değerlendirmesi (ISO 42001 çerçevesinde)

Kurumsal YZ kullanım politikası (AI Policy) hazırlanması

Onaylı araç envanteri ve sınıflandırma çerçevesi

KVKK + ISO 42001 uyum GAP analizi

YZ tedarikçileri güvenlik değerlendirmesi (TPRM)

ISO 27001 BGYS’ye YZ yönetişim entegrasyonu

ISO 42001 sertifikasyon hazırlık yol haritası

EU AI Act uyum ön hazırlığı (AB’ye ihracat yapanlar için)

Retainer model: Sürekli YZ yönetişim desteği

Eğitim mi, Danışmanlık mı — Ne Zaman Hangisi?

Eğitim ile başlayın, eğer:

- Çalışanlarda YZ risk farkındalığı yoksa

- YZ politikasını iletmek için somut bir platform arıyorsanız

- BGYS veya KVKK kapsamında “çalışan eğitimi” kanıtı gerekiyorsa

Danışmanlık ile başlayın, eğer:

- Kurumda YZ politikası hiç yoksa

- ISO 42001 sertifikasyonu veya uyum hazırlığı gerekiyorsa

- YZ araçlarının güvenlik değerlendirmesi yapılmamışsa

7. Sık Sorulan Sorular

ChatGPT’yi tamamen yasaklamalı mıyız?

Yasak stratejisi çalışmaz. BCG verilerine göre çalışanların %54’ü yasaklara rağmen YZ kullanmaya devam edeceğini belirtiyor — bu sefer daha gizli. Yasak Shadow AI’ı ortadan kaldırmaz, görünmez kılar. Asıl hedef, yapay zekayı onaylı araçlarla, net veri sınıflandırması ve izleme mekanizmasıyla yönetmektir. Yasaklamak yerine kontrol altına almak hem güvenli hem de rekabetçi kalmak açısından doğru yaklaşımdır.

Microsoft Copilot veya Google Workspace AI güvenli mi?

Kurumsal (Enterprise) lisanslı versiyonları tüketici versiyonlarına göre çok daha güvenlidir: veriler model eğitimine dahil edilmez, Avrupa veri merkezi seçeneği mevcuttur, GDPR/KVKK uyumlu veri işleme taahhüdü bulunur. Ancak “güvenli” etiketinin tek başına yeterli olmadığını vurgulamak gerekir. Aracın güvenli olması, kullanım biçiminin güvenli olduğu anlamına gelmez. Yanlış veri sınıfında içerik girişi, Enterprise lisansla da KVKK riski yaratabilir. Araç seçimi ve kullanım politikası birlikte değerlendirilmelidir.

ISO 42001 sertifikasyonu zorunlu mu, ne zaman mantıklı olur?

Türkiye’de şu an zorunlu değil. Ancak şu senaryolarda güçlü bir stratejik tercih haline gelir: AB pazarına hizmet veren kurumlar için EU AI Act uyum kanıtı, yapay zeka geliştiren veya kritik YZ sistemleri işleten kurumlar, ISO 27001 sertifikasına sahip olup yönetim sistemini genişletmek isteyenler ve kurumsal müşterilere güven sinyali vermek isteyen teknoloji şirketleri. ISO 27001 altyapısı üzerine inşa edildiği için ek yük görece düşük ve sinerjik bir geçiş söz konusu.

Çalışan YZ aracına kişisel veri girdiyse KVKK ihlali sayılır mı?

KVKK kapsamında veri sorumlusu olan kurum, çalışanının eylemlerinden sorumludur. Çalışan kişisel veri içeren bir dosyayı yurt dışı sunuculu bir YZ aracına yüklediyse bu, Madde 9 kapsamında izinsiz yurt dışı veri aktarımı sayılabilir. Kurul’a bildirim ve soruşturma yükümlülüğü doğabilir. Bu nedenle politika ve eğitim, hem kurumu hem çalışanı korur. Kullanım politikası olmayan kurumun “haberim yoktu” savunması giderek güçsüzleşmektedir.

Yapay zeka yönetişim danışmanlığı ne kadar sürer?

Temel paket (mevcut durum analizi + YZ politikası + araç sınıflandırması) 4-6 hafta içinde tamamlanabilir. ISO 42001 hazırlığı dahil kapsamlı bir yönetişim çerçevesi 3-6 ay sürer. Eğitim ise bağımsız olarak planlanabilir; baskı altındaki bir Kurul denetim süreci veya ISO 27001 gözetim denetimi öncesinde birkaç günde hayata geçirilebilir. Sürekli destek için yıllık retainer modeli de sunmaktayız.

Secure Fors — YZ Yönetişim Hizmetleri

Yapay Zekayı Kontrol Altına Alın —

İnovasyondan Ödün Vermeden

Shadow AI tespiti, yapay zeka politikası, KVKK uyumu ve ISO 42001 çerçevesi konularında hem eğitim hem danışmanlık hizmeti sunuyoruz. ISO 27001 Lead Auditor ve siber güvenlik sertifikasyonlarımızla kurumunuzun yapay zeka yönetişim altyapısını birlikte kuruyoruz.

Güvenli YZ Kullanımı Eğitimi (tüm çalışanlar veya teknik ekip)

Kurumsal YZ kullanım politikası (AI Policy) hazırlanması

Yapay zeka risk değerlendirmesi ve araç envanteri

KVKK + ISO 42001 uyum GAP analizi

YZ tedarikçileri güvenlik değerlendirmesi

ISO 42001 sertifikasyon hazırlık yol haritası