Kurumların Yapay Zeka Kullanımında Yaptığı Kritik Hatalar: Bilgi Güvenliği ve Siber Güvenlik Riskleri

Shadow AI, LLM zehirlenmesi, prompt injection, kontrolsüz entegrasyonlar ve AI yönetişim eksiklikleri — gerçek dünya vakaları ve kurumsal koruma stratejileri.

erişim kontrolü eksikliği

bulunmayan kuruluşlar

ihlal yaşayan kuruluşlar

ortalama ek maliyet

1. Yapay Zeka Çağında Güvenlik Paradoksu

Yapay zeka araçları iş dünyasında benzeri görülmemiş bir hızla yayılıyor. ChatGPT, GitHub Copilot, Google Gemini ve Claude gibi üretken yapay zeka platformları; kod yazmadan toplantı notlarına, müşteri analizlerinden strateji belgelerine kadar her alanda aktif olarak kullanılıyor. Ancak bu hızlı benimseme süreci, güvenlik ve yönetişim altyapısının çok gerisinde kalıyor.

IBM'ın Ponemon Enstitüsü ile birlikte yürüttüğü 2025 Cost of a Data Breach Report'a göre, AI modelleri veya uygulamalarında veri ihlali yaşayan kuruluşların %97'sinde yeterli AI erişim kontrollerinin bulunmadığı tespit edilmiştir. Daha da çarpıcı olan bulgu: ihlal yaşayan kuruluşların %63'ünün ya bir AI yönetişim politikasına sahip olmadığı ya da böyle bir politikayı hâlâ geliştirme aşamasında olduğudur.

2023–2025 yılları arasında yaşanan Samsung, McDonald's ve Microsoft Copilot gibi yüksek profilli olaylar, AI güvenliğinin artık yalnızca IT departmanlarının değil, üst yönetimin de stratejik gündemine alınması gerektiğini kanıtlamıştır. Bu yazıda, kurumların AI kullanımında en sık düştüğü kritik hataları, bu hataların yarattığı bilgi güvenliği ve siber güvenlik risklerini ve gerçek dünyadan vaka çalışmalarıyla birlikte ele alıyoruz.

2. Kritik Verilerin Yapay Zeka Araçlarıyla Paylaşılması

Kurumların AI kullanımında en yaygın ve en tehlikeli hatalarından biri, çalışanların hassas kurumsal verileri doğrudan LLM (Large Language Model) tabanlı araçlara yapıştırmasıdır.

Yapay zeka araçlarına veri yapıştıran çalışanlar günde ortalama 6,8 yapıştırma işlemi yapmakta ve bunların 3,8'i hassas kurumsal veri içermektedir. Bu manuel ve görünmez süreç, geleneksel DLP sistemlerini, güvenlik duvarlarını ve erişim kontrollerini tamamen atlatmaktadır.

Samsung'un yarı iletken bölümü mühendisleri, ChatGPT kullanımına izin verildikten yalnızca üç hafta içinde üç ayrı veri sızıntısı olayına neden olmuştur.

Bir mühendis, hatalı bir veritabanı yazılımının kaynak kodunu ChatGPT'ye yapıştırarak çözüm aramış; bir diğeri çip üretim süreçlerindeki arızalı ekipman tespit kodunu optimizasyon için paylaşmış; üçüncü bir çalışan ise dahili şirket toplantısının ses kaydını metne dönüştürerek toplantı tutanağı hazırlatmak için ChatGPT'ye girmiştir.

Bu veriler OpenAI'ın sunucularında saklanarak model eğitiminde kullanılmış ve Samsung açısından geri alınamaz bir ticari sır kaybına yol açmıştır. Samsung önce prompt başına 1024 bayt sınırlaması getirmiş, ardından tüm üretken yapay zeka araçlarını geçici olarak yasaklamış ve iç kullanım için kendi yapay zeka sistemi Gauss'u geliştirmeye başlamıştır.

Bu olay, veri sınıflandırması yapılmadan ve kullanım politikaları belirlenmeden AI araçlarının çalışanlara açılmasının ne denli riskli olduğunu somut biçimde göstermektedir. Özellikle kaynak kod, müşteri verileri, finansal raporlar ve stratejik toplantı notları gibi gizlilik dereceli bilgiler, hiçbir koşulda harici AI platformlarıyla paylaşılmamalıdır.

3. Shadow AI: Görünmeyen ve Kontrol Edilemeyen Tehdit

Shadow AI, kurumun bilgi güvenliği ekiplerinin bilgisi ve onayı dışında, çalışanların kendi inisiyatifleriyle kullandıkları yapay zeka araçlarını ifade eder. Bu durum, klasik "Shadow IT" kavramının çok daha tehlikeli bir evrimidir; çünkü AI araçları yalnızca veri depolamakla kalmaz, aktif olarak veriyi işler, analiz eder ve üçüncü taraf sunucularına iletir.

- Her 5 kuruluştan 1'i Shadow AI kaynaklı bir veri ihlali yaşamıştır.

- Shadow AI ihlallerinin maliyeti, geleneksel ihlallere kıyasla ortalama 670.000 USD daha yüksektir.

- Kuruluşların yalnızca %37'si Shadow AI'ı yönetecek veya tespit edecek bir politikaya sahiptir.

- Shadow AI ihlalleri ortalama 247 gün sürede tespit edilmektedir (genel ortalamanın üzerinde).

- Bu ihlallerin %65'inde müşteri kişisel verileri, %40'ında fikri mülkiyet hakları etkilenmiştir.

LayerX araştırması, GenAI erişimlerinin %71,6'sının kurumsal olmayan hesaplar üzerinden gerçekleştiğini ortaya koymuştur. Bu, çalışanların kişisel hesaplarıyla AI araçlarına erişerek kurumsal DLP (Data Loss Prevention) sistemlerini, güvenlik duvarlarını ve erişim kontrollerini tamamen atladığı anlamına gelmektedir.

Üretken yapay zeka araçlarının tamamını engellemek pratik bir çözüm değildir; çalışanları alternatif yollar bulmaya yönlendirir ve inovasyon kapasitesini sınırlar. Doğru yaklaşım, güvenli kullanım (safe enablement) modelini benimsemektir: onaylı araçları belirlemek, veri paylaşım kurallarını netleştirmek ve kullanımı izleyebilir hale getirmek.

4. Kontrolsüz ve Güvensiz LLM Entegrasyonları

Birçok kurum, iş süreçlerini hızlandırmak amacıyla LLM tabanlı chatbot'ları, kod asistanlarını ve otomasyon araçlarını yeterli güvenlik değerlendirmesi yapmadan üretim ortamlarına aktarmaktadır. Zayıf kimlik doğrulama mekanizmaları, varsayılan parolalar, eksik erişim kontrolleri ve güvenlik açığı taşıyan API yapıları, bu entegrasyonları ciddi saldırı yüzeylerine dönüştürmektedir.

Haziran 2025'te güvenlik araştırmacıları Ian Carroll ve Sam Curry, McDonald's'ın işe alım süreçlerinde kullandığı ve Paradox.ai tarafından geliştirilen McHire platformundaki AI chatbot "Olivia"da kritik güvenlik açıkları tespit etmiştir.

Araştırmacılar, 2019'dan beri aktif olan bir test hesabına kullanıcı adı ve parola olarak "123456" girerek yönetici erişimi elde etmiştir. Çok faktörlü kimlik doğrulama (MFA) bulunmayan bu hesap üzerinden, IDOR (Insecure Direct Object Reference) zafiyeti ile 64 milyon iş başvuru sahibinin kişisel bilgilerine — isim, e-posta, telefon numarası ve sohbet transkriptleri dahil — erişim sağlanabildiği ortaya çıkmıştır.

Paradox.ai, hesabın aynı gün devre dışı bırakıldığını ve bir bug bounty programı başlattığını açıklamıştır. Ancak kurumsal AI benimseme hızının (%187 artış, 2023–2025) güvenlik yatırımlarının (%43 artış) çok önünde gittiği bir kez daha teyit edilmiştir.

Kurumlar, AI entegrasyonlarını devreye almadan önce mutlaka kapsamlı güvenlik değerlendirmesi, sızma testi, erişim kontrol denetimi ve API güvenlik analizi gerçekleştirmelidir. Üçüncü taraf AI çözüm sağlayıcılarının güvenlik olgunluk seviyesi, sözleşme öncesinde detaylı şekilde değerlendirilmelidir.

5. LLM Zehirlenmesi (Data Poisoning & Model Manipulation)

LLM zehirlenmesi, yapay zeka modellerinin eğitim verilerine veya bilgi tabanlarına kasıtlı olarak manipüle edilmiş içerik enjekte edilerek modelin davranışının değiştirilmesini ifade eder. Bu saldırı türü, özellikle RAG (Retrieval-Augmented Generation) mimarisi kullanan kurumsal AI sistemleri için ciddi bir tehdit oluşturmaktadır.

Anthropic araştırma ekibi: Yalnızca 250 zararlı belgenin, 600 milyon ile 13 milyar parametre arasındaki LLM modellerini başarıyla zehirleyebildiğini göstermiştir. Bu bulgu, daha büyük modellerin orantılı olarak daha fazla zehirli veriye ihtiyaç duyduğu varsayımını çürütmektedir.

PoisonedRAG araştırması: Milyonlarca belgeden oluşan bir veri havuzuna yalnızca 5 zararlı belge eklenerek, belirli sorularda %90 oranında yanlış yanıt üretilmesinin sağlanabildiği ortaya konmuştur.

LLM Zehirlenmesinin Kritik Risk Alanları

- Sağlık sektörü: Tanı modellerinin manipülasyonu ile hatalı tedavi önerileri üretilmesi

- Finans sektörü: Kredi skorlama ve dolandırıcılık tespit sistemlerinin yanıltılması

- Hukuk: Sözleşme analiz araçlarının hatalı yönlendirilmesi

- Kurumsal bilgi tabanları: RAG sistemlerindeki dokümanların kasıtlı olarak bozulması

Kurumlar, RAG sistemlerindeki bilgi tabanlarının bütünlüğünü sürekli izlemeli, veri kaynağı doğrulama mekanizmaları kurmalı ve model çıktılarını düzenli olarak denetlemelidir.

6. Prompt Güvenliği (Prompt Injection & Prompt Leakage)

OWASP'ın 2025 LLM Top 10 listesinde birinci sıraya yerleştirdiği Prompt Injection, AI güvenliğinin en kritik zafiyet türlerinden biridir. Bu saldırıda, kötü niyetli kullanıcılar özel olarak hazırlanmış girdi metinleriyle modelin davranışını değiştirir, güvenlik önlemlerini atlar veya hassas bilgilere erişim sağlar.

Doğrudan Prompt Injection

Kullanıcının doğrudan modele manipülatif girdi göndererek sistem talimatlarını geçersiz kılmasıdır. Microsoft'un Bing Chat'inde ("Sydney" olayı), bir Stanford Üniversitesi öğrencisi basit bir "önceki talimatları yoksay" komutuyla AI'ın dahili yönergelerini ve kod adını ifşa etmeyi başarmıştır.

Dolaylı Prompt Injection (Indirect Prompt Injection)

Daha tehlikeli olan bu yöntemde, saldırganlar web sayfalarına, belgelere veya e-postalara gizli talimatlar yerleştirerek AI'ın bu içerikleri işlemesi sırasında modelin davranışını manipüle eder.

- Slack AI veri sızıntısı (2024): RAG zehirlenmesi ve sosyal mühendislik kombinasyonuyla kurumsal veri sızdırılması

- Microsoft 365 Copilot EchoLeak — CVE-2025-32711 (2025): Sıfır tıklama ile kurumsal veri sızıntısına olanak tanıyan zafiyet

- ChatGPT bellek zafiyeti (2024): Kalıcı prompt injection ile birden fazla oturum boyunca veri sızdırma

- GPT Store botları (2024): Özel GPT'lerin prompt injection ile sistem talimatlarını ve API anahtarlarını ifşa etmesi

- GitHub Copilot RCE — CVE-2025-53773 (2025): Kod deposundaki zararlı yorumlar üzerinden uzaktan kod çalıştırma

E-posta tabanlı dolaylı prompt injection özellikle tehlikelidir: kurbanın e-postasına gizli talimatlar içeren mesajlar gönderilir ve AI asistanı bu mesajları işlediğinde zararlı komutlar çalıştırılır. Kurbanın herhangi bir linke tıklaması veya ek indirmesi gerekmez — yalnızca AI asistanının e-postayı okuması yeterlidir.

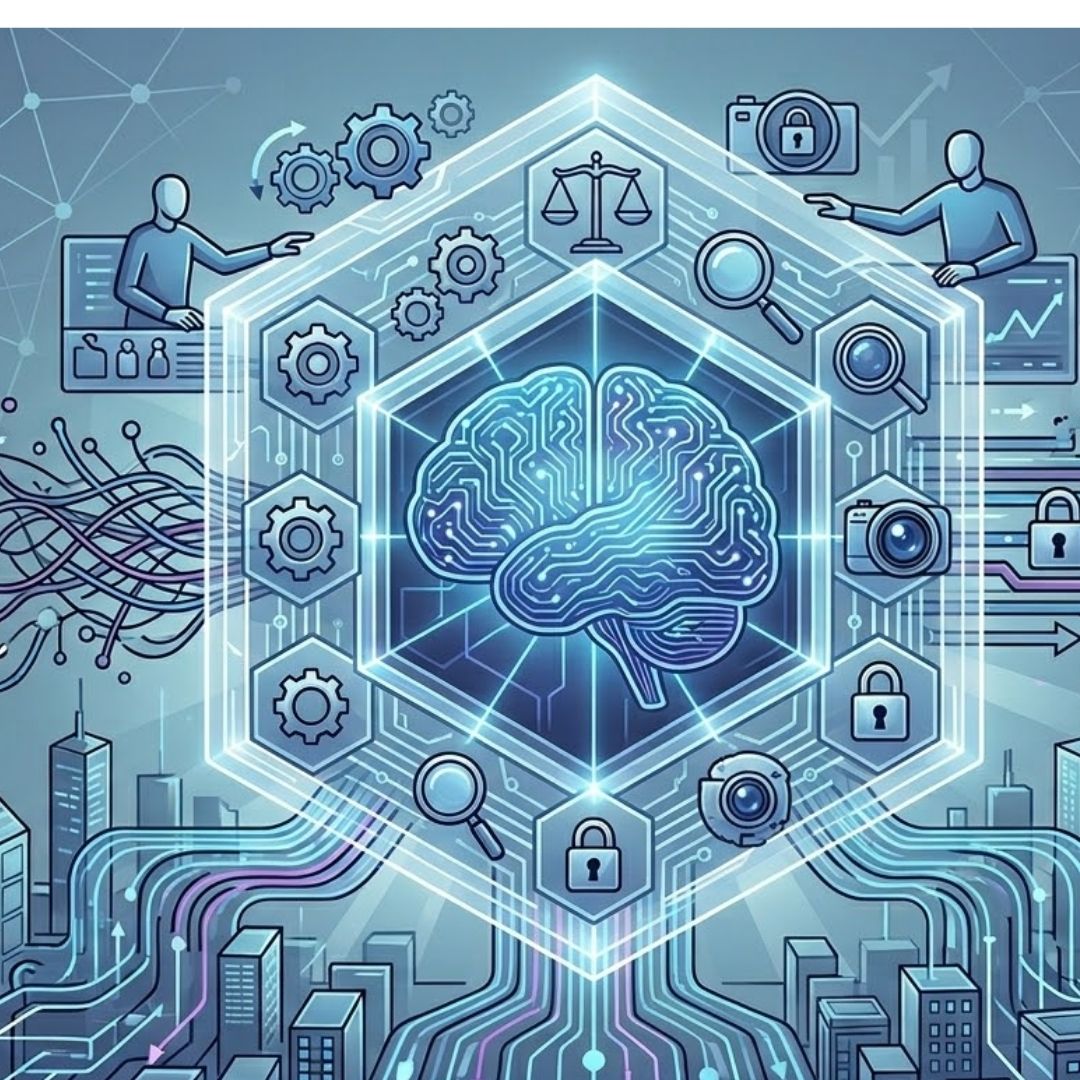

7. AI Yönetişim Eksikliği: Kurumların En Büyük Açığı

Yukarıda ele alınan tüm risklerin temelinde, kurumların yapay zeka yönetişimini henüz sistematik bir şekilde ele almamış olması yatmaktadır. AI yönetişimi; politika geliştirme, risk değerlendirme, erişim kontrolü, denetim mekanizmaları, regülasyon uyumu ve sürekli izleme gibi birçok bileşeni kapsayan bütünsel bir yaklaşımı gerektirir.

Kurumların AI Yönetişiminde Sık Karşılaşılan Eksiklikler

- AI Kullanım Politikası Eksikliği: Hangi AI araçlarının, hangi verilerle ve hangi koşullarda kullanılabileceğine dair net bir kurumsal politikanın bulunmaması.

- Veri Sınıflandırma Eksikliği: Hangi verilerin AI araçlarıyla paylaşılabileceği konusunda sınıflandırma ve etiketleme yapılmamış olması.

- Üçüncü Taraf Risk Yönetimi: AI çözüm sağlayıcılarının güvenlik değerlendirmesinin, tedarikçi risk yönetimi (TPRM) süreçlerine dahil edilmemesi.

- Denetim ve İzleme Mekanizmaları: AI kullanımının loglanması, izlenmesi ve düzenli olarak denetlenmesine yönelik mekanizmaların kurulmaması.

- Regülasyon Uyumu: AB Yapay Zeka Tüzüğü'nün (AI Act) 2026 tam uygulaması, KVKK'nın otomatik karar alma süreçlerine ilişkin yükümlülükleri ve BDDK'nın 2025-2028 Stratejik Planı'ndaki AI düzenlemelerine hazırlıksız yakalanma riski.

- Farkındalık ve Eğitim: Çalışanlara AI güvenliği konusunda yeterli eğitim verilmemesi ve farkındalık programlarının oluşturulmaması.

8. Rakamlarla AI Güvenlik Riskleri: 2025 Verileri

| Metrik | Veri / Bulgu | Kaynak |

|---|---|---|

| AI ihlallerinde erişim kontrolü eksikliği | %97 | IBM / Ponemon 2025 |

| AI yönetişim politikası eksikliği | %63 | IBM / Ponemon 2025 |

| Shadow AI kaynaklı ihlal oranı | Her 5 kuruluştan 1'i | IBM / Ponemon 2025 |

| Shadow AI ihlallerinin ek maliyeti | +670.000 USD | IBM / Ponemon 2025 |

| GenAI'a yapıştırılan verilerde kurumsal bilgi oranı | %50+ | LayerX Security 2025 |

| Kurumsal olmayan hesaplarla GenAI erişimi | %71,6 | LayerX Security 2025 |

| McDonald's AI ihlalinde etkilenen kişi sayısı | 64 milyon | CSO Online 2025 |

| Sağlık sektörü ortalama ihlal maliyeti | 7,42 milyon USD | IBM / Ponemon 2025 |

| Shadow AI ihlali tespit süresi | 247 gün | IBM / Ponemon 2025 |

| RAG zehirlemesi başarı oranı (5 zararlı belge ile) | %90 | PoisonedRAG Araştırması |

9. Kurumların Alması Gereken Stratejik Önlemler

Yapay zeka güvenliğini sağlamak için kurumların teknik kontroller, yönetişim süreçleri ve insan faktörünü bir arada ele alan çok katmanlı bir yaklaşım benimsemesi gerekmektedir.

9.1 AI Yönetişim Çerçevesi Oluşturma

- Kapsamlı bir AI Kullanım Politikası (Acceptable Use Policy) geliştirerek onaylı araçları, kullanım koşullarını ve veri paylaşım kurallarını netleştirin.

- AI Risk Değerlendirme Metodolojisi oluşturarak her yeni AI aracını devreye almadan önce güvenlik, mahremiyet ve uyum değerlendirmesi yapın.

- AI Yönetişim Komitesi kurarak bilgi güvenliği, hukuk, uyum, IT ve iş birimlerinden temsilcilerin katılımıyla düzenli gözden geçirme toplantıları düzenleyin.

9.2 Teknik Güvenlik Kontrolleri

- AI özelinde DLP (Data Loss Prevention) çözümleri uygulayarak hassas verilerin GenAI araçlarına sızmasını engelleyin.

- Prompt güvenliği katmanları (prompt firewalls, input/output sanitization) devreye alarak prompt injection saldırılarına karşı koruma sağlayın.

- AI araçlarına erişimde merkezi kimlik doğrulama (SSO), en az yetki prensibi ve MFA uygulayın.

- RAG sistemlerindeki bilgi tabanlarının bütünlüğünü sürekli izleyen ve anomali tespit eden mekanizmalar kurun.

9.3 Üçüncü Taraf AI Risk Yönetimi

- AI çözüm sağlayıcılarını tedarikçi güvenlik değerlendirme (TPRM) süreçlerine dahil edin.

- Sözleşmelere veri koruma, erişim hakları, ihlal bildirimi, denetim hakkı ve SLA maddeleri ekleyin.

- AI sağlayıcılarının düzenli penetrasyon testi ve güvenlik denetimine tabi tutulmasını zorunlu kılın.

9.4 Farkındalık ve Sürekli Eğitim

- Tüm çalışanlara AI güvenliği odaklı farkındalık eğitimleri düzenleyin.

- Teknik ekiplere prompt güvenliği, LLM zafiyetleri ve güvenli AI geliştirme pratikleri konusunda uzmanlık eğitimleri sağlayın.

- AI güvenlik olaylarını simüle eden masabaşı egzersizleri düzenleyin.

9.5 Türkiye'deki Kurumlara Özel Değerlendirme

Türkiye'de 7545 sayılı Siber Güvenlik Kanunu ve KVKK düzenlemeleri çerçevesinde yapay zeka kaynaklı veri sızıntıları ayrı bir önem taşımaktadır. Kişisel verilerin yurt dışındaki yapay zeka sunucularına aktarılması, açık rıza olmaksızın KVKK ihlali oluşturabilir. AB Yapay Zeka Tüzüğü'nün (AI Act) 2026'da tam uygulamaya geçmesi ve BDDK'nın 2025–2028 Stratejik Planı'ndaki AI düzenlemeleri, Türkiye'deki kurumlar için AI güvenliğini ertelenebilir bir konu olmaktan çıkarmıştır.

10. Sonuç: Güvenli AI Kullanımı Stratejik Bir Zorunluluktur

Yapay zeka, kurumlar için muazzam verimlilik kazanımları ve rekabet avantajı sunmaktadır. Ancak bu teknolojinin güvenlik ve yönetişim altyapısı olmadan benimsenmesi, organizasyonları veri sızıntısı, fikri mülkiyet kaybı, regülasyon ihlalleri ve itibar hasarı gibi ciddi risklerle karşı karşıya bırakmaktadır.

Samsung'un ticari sır kaybı, McDonald's'ın 64 milyon kişilik veri ifşası, Shadow AI'ın yıkıcı maliyetleri ve Microsoft Copilot'taki sıfır tıklama zafiyetleri, bu risklerin teorik değil son derece gerçek olduğunu kanıtlamaktadır.

Secure Fors AI Güvenliği & Yönetişim Hizmetleri

Yapay zeka çağında veri güvenliğinizi şansa bırakmayın. Secure Fors olarak, kurumların yapay zeka sistemlerinin teknik güvenliğinden regülasyon uyumuna, etik yönetişimden risk yönetimine kadar her boyutta kapsamlı danışmanlık ve değerlendirme hizmetleri sunuyoruz.

Kaynaklar ve Referanslar

- IBM / Ponemon Institute — "Cost of a Data Breach Report 2025," Temmuz 2025 — newsroom.ibm.com

- LayerX Security — "Enterprise AI and SaaS Data Security Report 2025" — esecurityplanet.com

- OWASP — "Top 10 for LLM Applications 2025" — genai.owasp.org

- Anthropic Research — "Small Samples Can Poison LLMs," 2025 — anthropic.com/research

- Samsung ChatGPT Data Leak — The Register, Cybersecurity Dive, Cybernews, Nisan 2023

- McDonald's McHire AI Breach — Wired, CSO Online, KrebsOnSecurity, Temmuz 2025

- Microsoft 365 Copilot CVE-2025-32711 (EchoLeak) — Lakera AI Research, 2025

- PoisonedRAG Research — Sombra Inc. / Academic Publications, 2024

- AB Yapay Zeka Tüzüğü (AI Act) — Avrupa Birliği Resmi Gazetesi

- Reco.ai — "AI & Cloud Security Breaches: 2025 Year in Review," Aralık 2025