LLM Sistemleri Neden Bildiğimiz

Güvenlik Testleriyle Korunamıyor?

Büyük dil modelleri, on yıldır güvendiğimiz araçları ve yöntemleri geçersiz kılıyor. Bu bir alarm değil — bir gerçeklik tespitidir.

On yılı aşkın süredir uygulama güvenliği belirli kalıplar üzerinden ilerledi: OWASP Top 10, sızma testi, zafiyet yönetimi. Girdi doğrulama, çıktı kodlama, erişim kontrolü. Her güvenlik uzmanının refleks hâline getirdiği savunma mekanizmaları.

Büyük dil modellerinin (LLM) iş süreçlerine entegrasyonuyla birlikte bu refleksler tek başına yeterli olmaktan çıktı. Saldırı yüzeyi değişti — ancak güvenlik test metodolojilerimiz henüz bu değişime ayak uyduramadı.

Bu yazı, güvenlik kararlarından sorumlu yöneticilere (CISO, CTO, Risk Direktörü) bu geçişin ne anlama geldiğini, kurumsal risk boyutunu ve acil atılması gereken adımları açıklamaktadır.

Herkes Kullanıyor, Kimse Test Etmiyor

Bu rakamlar kritik bir paradoksu gözler önüne seriyor: Kurumların büyük çoğunluğu LLM sistemlerini aktif olarak kullanıyor; ancak bu sistemleri güvenli kılmak için ne yapmaları gerektiğini henüz tam olarak kavramış değil.

CISO’ların %67’si AI risklerini yüksek öncelikli görmesine karşın yalnızca %12’sinin yazılı bir AI güvenlik politikası bulunması, strateji ile uygulama arasındaki derin uçurumu ortaya koyuyor.

Aynı Girdi, Farklı Çıktı — Test Sonuçlarına Güvenebilir misiniz?

Geleneksel uygulama güvenliğinin en temel özelliği deterministik yapısıdır: Bir web uygulamasına ' OR 1=1 -- gönderdiğinizde sonuç öngörülebilirdir. LLM’lerde ise aynı girdi farklı yanıtlar üretebilir.

| 🔵 Geleneksel Mimari | 🔴 LLM Tabanlı Mimari |

|---|---|

| ✓ Deterministik Çıktılar Aynı girdi her zaman aynı sonucu üretir | ⚠ Non-Deterministik Çıktılar Aynı girdi farklı, olasılıksal yanıtlar üretebilir |

| ✓ Kod Tanımlı Davranış Uygulama mantığı açıkça programlanır | ⚠ Model Belirlenimli Davranış Mantık, model tarafından dinamik çıkarımlanır |

| ✓ Tekrarlanabilir Test Senaryolar tutarlı sonuçlar verir | ⚠ Değişken Test Sonuçları Sonuçlar her çalıştırmada dalgalanır |

| ✓ Teknik Saldırı Vektörleri Protokol/sözdizim/mantık açıkları | ⚠ Semantik Saldırı Vektörleri Doğal dil manipülasyonu yeterli |

SQL’den Prompt’a: Saldırı Yüzeyi Baştan Tanımlandı

Geleneksel uygulamalarda saldırı vektörleri teknik yapılardır: SQL sorguları, HTTP başlıkları, serileştirilmiş nesneler. LLM sistemlerinde ise saldırı vektörü doğal dilin kendisidir.

| Geleneksel Uygulama | LLM Uygulaması | Risk | |

|---|---|---|---|

| SQL Injection | → | Prompt Injection | KRİTİK |

| XSS | → | Indirect Prompt Injection | YÜKSEK |

| SSRF | → | Excessive Agency | YÜKSEK |

| Broken Access Control | → | Insecure Plugins | ORTA |

| Input Validation | → | Data Leakage | YÜKSEK |

Gerçek Senaryo: Müşteri Hizmetleri Chatbot’u Nasıl Manipüle Edildi?

2023 yılında bir güvenlik araştırmacısı, Bing Chat’in sistem prompt’unu basit bir prompt injection tekniğiyle sızdırdı. En gelişmiş LLM entegrasyonlarının bile bu saldırı türüne karşı kırılgan olduğunu gösterdi.

Mevcut Güvenlik Araçlarınız Neden Yetersiz Kalıyor?

Bu araçların kötü olduğu anlamına gelmez — farklı bir problem için üretilmiş olmaları nedeniyle LLM davranışını test etmekte yetersiz kalırlar.

| Araç | Ne Yapar? | LLM için Neden Yetersiz? |

|---|---|---|

| SAST | Kaynak kodu statik analiz eder | Tehlikeli davranış modelin ağırlıklarında — kodda değil |

| DAST | HTTP trafiğini dinamik inceler | LLM saldırıları normal HTTP isteği gibi görünür |

| Pentest | Bilinen vektörleri test eder | LLM saldırı yüzeyi sürekli evrilir; liste geride kalır |

| WAF | İmza tabanlı engelleme yapar | Doğal dil imzaları sonsuz varyasyonla atlar |

LLM Güvenliği için Özel Araçlar

- Garak (NVIDIA): LLM güvenlik açıklarını otomatik tespit eden açık kaynaklı çerçeve.

- PyRIT (Microsoft): Red teaming için AI odaklı test altyapısı.

- Promptfoo: Prompt güvenliğini ve model davranışını test eden değerlendirme platformu.

Kurumsal Risk Matrisi: İş Etkisi Ne?

LLM güvenlik açıkları salt teknik bir sorun değildir. İş sürekliliği, müşteri güveni ve hukuki sorumluluk boyutları olan kurumsal bir risktir.

| Risk Alanı | Teknik Etki | Kurumsal Senaryo |

|---|---|---|

| KRİTİK Veri Sızdırma | Eğitim ve çıkarsama verilerinin yetkisiz ifşası | PII/PHI sızıntısı, API anahtarı açığa çıkması |

| KRİTİK Yetkisiz Eylem | LLM ajanlarının aşırı yetkisi | Kritik veritabanı silme, yetkisiz finansal işlemler |

| YÜKSEK İtibar Kaybı | Model zehirlenmesi / Halüsinasyon yayılımı | Viral marka krizleri, müşteri güveninin erozyonu |

| ORTA Uyum Başarısızlığı | AB AI Yasası gibi düzenleyici standartların ihlali | İdari cezalar, operasyonel askıya alma |

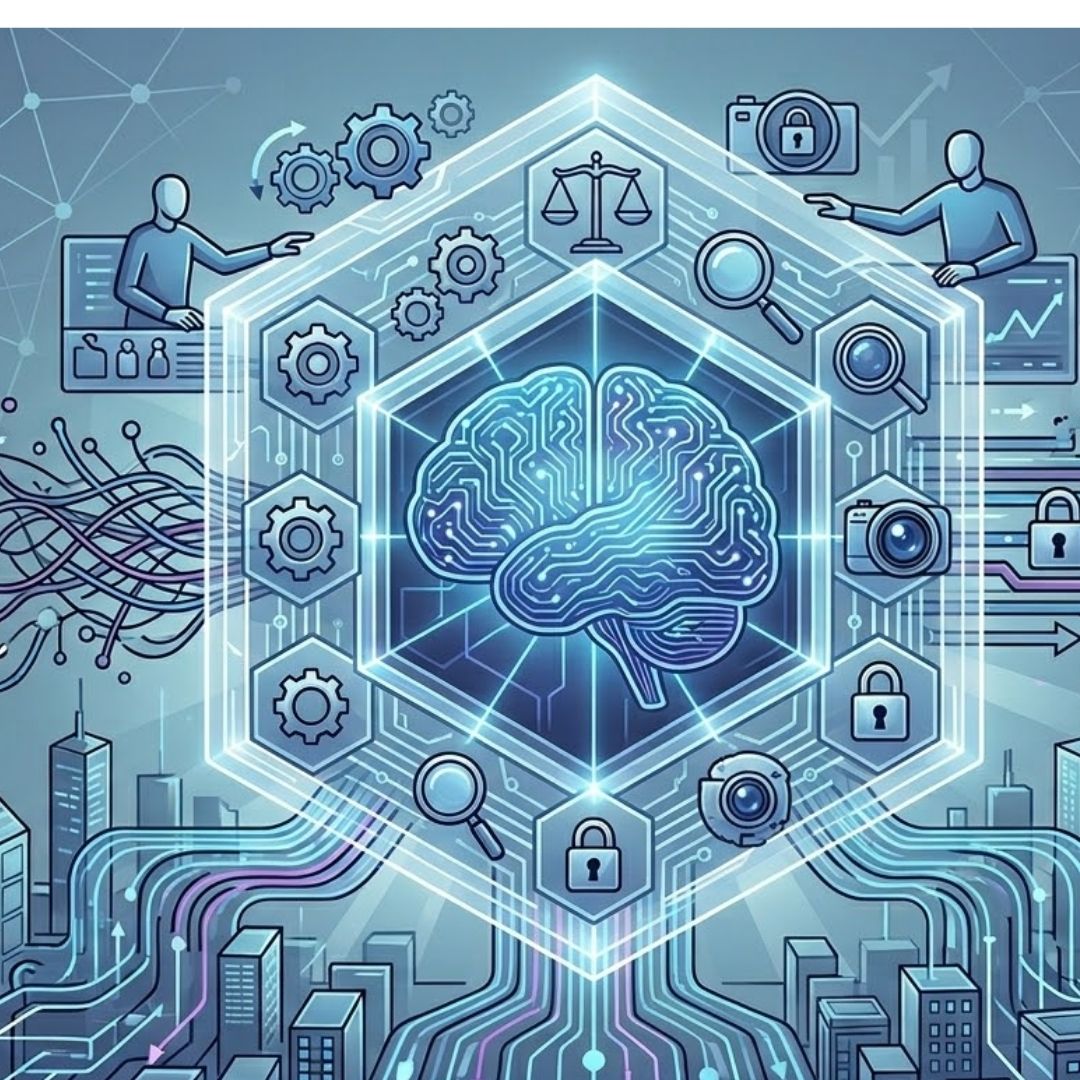

Uyum Boyutu: Düzenleyici Çerçeveler

- AB AI Yasası: Yüksek riskli AI sistemleri için zorunlu güvenlik değerlendirmesi gerektiriyor

- NIST AI RMF: AI risk yönetimi için kapsamlı çerçeve

- ISO 42001: AI yönetim sistemleri için uluslararası standart — ISO 27001’in AI uzantısı

- MITRE ATLAS: AI sistemlerine yönelik saldırı taktiklerini kataloglayan tehdit istihbarat çerçevesi

Bu Seri Boyunca Ne Öğreneceksiniz?

Değişen Saldırı Yüzeyi ŞU AN

Geleneksel güvenlik paradigmalarının temel sınırlamaları ve LLM’lerin getirdiği yeni risk boyutu

Prompt Injection

Üretken AI çağında SQL injection’ın analojisi: doğrudan ve dolaylı saldırı mekanizması

OWASP LLM Top 10

En kritik 10 güvenlik açığı kategorisi — her madde kurumsal senaryo ve önlem önerileriyle

Standartlar ve Düzenlemeler

NIST AI RMF, MITRE ATLAS, ISO 42001 ve AB AI Yasası

Değerlendirme Metodolojileri

Garak, PyRIT, Promptfoo: Kurumsal ortamda pratik araç kullanımı

CISO’lar için Stratejik Yol Haritası

Kapsamlı 5 adımlı uygulama planı: önceliklendirme, bütçe, ekip ve ölçüm metrikleri

Gelecekteki Tehdit Ortamı

Otonom AI ajanları ve genişleyen saldırı vektörleri: 2026 ve sonrası için hazırlık

Hemen Yapılacaklar: CISO Aksiyon Planı

Kısa Vadeli Aksiyonlar

Orta Vadeli Aksiyonlar

Sonuç: Göremediğinizi Koruyamazsınız

LLM sistemleri, geleneksel uygulama güvenlik paradigmalarının tasarlanmadığı bir tehdit ortamı yaratıyor. Saldırı vektörü doğal dilin kendisi olduğunda, imza tabanlı araçlar ve deterministik test yöntemleri yetersiz kalıyor.

Bu bir araçları bir kenara bırakma çağrısı değil; mevcut araçlara ek olarak AI’a özgü güvenlik katmanlarını benimseme zorunluluğunun kabulüdür.

İlk adım, bu yüzeyin varlığını kabul etmektir. Bu yazıyı okuyan her güvenlik lideri o adımı atmış demektir.