01Shadow AI Nedir?

Shadow AI; kurumun resmi onay süreçlerinden geçmemiş, BT veya güvenlik birimi tarafından denetlenmeyen ve şirket politikalarının kapsama almadığı yapay zekâ araçlarının çalışanlar tarafından iş amaçlı kullanılmasıdır. KVKK’nın Şubat 2026 rehberinde bu olgu Gölge Yapay Zekâ (Gölge YZ) olarak resmi biçimde tanımlanmaktadır.

Kavram, onlarca yıldır gündemde olan Shadow IT‘nin doğal evrimi olarak karşımıza çıkar. Fark şudur: ChatGPT, Gemini, Claude, Copilot, Perplexity gibi araçlar kredi kartı bile gerekmeden, tek tıklamayla erişilebilir durumdadır.

Sorun kullanımın kendisinden değil, bu kullanımın görünmez olmasından kaynaklanmaktadır. Bir pazarlama uzmanı müşteri verisiyle beslediği bir prompt’u ChatGPT’ye yapıştırdığında, ne CISO’nun ne de hukuk departmanının haberi olmaz. Artık bu durumun yalnızca operasyonel değil, hukuki sonuçları da mevcuttur.

Shadow IT’yi kontrol altına almak için yıllarca mücadele verdik. Shadow AI ise bu mücadelenin çok daha hızlı hareket eden ve artık düzenleyici otorite tarafından da izlenen yeni bölümüdür.

// Rakamlarla Shadow AI

02KVKK Şubat 2026: Artık Tercih Değil

Uzun süre “iyi uygulama” meselesi olarak ele alınan Shadow AI yönetimi, Şubat 2026 itibarıyla Türkiye’de açık bir düzenleyici boyut kazanmıştır. KVKK, “İş Yerlerinde Üretken Yapay Zekâ Araçlarının Kullanımı” başlıklı rehberini yayımlayarak kurumların bu alanda hareketsiz kalamayacağını ortaya koymuştur.

Rehber; 6698 sayılı Kanun çerçevesinde değerlendirilmekte olup veri sorumlusu konumundaki kurum ve kuruluşlara yönelik somut beklentiler içermektedir.

// KVKK Rehberi — Kurumlar İçin Temel Yükümlülükler

Çalışanların üçüncü taraf AI araçlarıyla işlediği kişisel verilerden kurum, veri sorumlusu sıfatıyla sorumlu tutulabilir. “Çalışan kendi inisiyatifiyle kullandı” savunması bu sorumluluğu ortadan kaldırmaz.

ÜYZ araçlarının iş yerinde kullanımına ilişkin açık bir politika oluşturulması beklenmektedir. Politikasızlık artık aktif uyumsuzluk göstergesidir.

Hangi araçların kullanıldığı, hangi veri türlerinin aktarıldığı ve çıktıların nasıl değerlendirildiğine dair kurumsal görünürlük sağlanmalıdır.

Hangi tür verilerin AI araçlarıyla paylaşılamayacağı konusunda çalışanların bilgilendirilmesi ve farkındalık faaliyetleri yürütülmesi öngörülmektedir.

Yabancı kökenli AI araçlarına kişisel veri aktarımı KVKK’nın yurt dışı aktarım hükümleri kapsamında değerlendirilmek zorundadır. “Ücretsiz araca yapıştırdım” bu yükümlülüğü ortadan kaldırmaz.

03Riskler Nelerdir?

Shadow AI’ın yarattığı riskler tek boyutlu değildir; veri gizliliği, hukuki yükümlülük, operasyonel bütünlük ve itibar başlıklarında iç içe geçmiş durumdadır.

// Risk Matrisi — 6 Kritik Alan

Kişisel veri, finansal kayıt veya ticari sır içeren prompt’ların AI servislerine iletilmesi KVKK kapsamında veri aktarımı sayılabilir. Model eğitimine dahil edilme riski görmezden gelinemez.

Kaynak kodu, tasarım dokümanları ve ticari strateji belgelerinin AI’a beslenmesi, kurumun rekabet avantajını geri dönüşü olmayacak biçimde tehlikeye atabilir.

Çalışanın kullandığı AI aracı başka bir SaaS entegrasyonuna bağlıysa, bu entegrasyonun güvenlik postürü kurumun doğrudan riski haline gelir.

Doğrulanmamış AI çıktılarının kurumsal süreçlere dahil edilmesi halüsinasyon kaynaklı hatalara zemin hazırlar. Hız kazanılırken doğruluk kaybedilir.

AI araçları verileri nerede işler, ne kadar saklar, kim erişir? Bu soruların yanıtsız kaldığı ortamlarda denetim izi oluşturmak imkânsızlaşır.

Onaylı olmayan araçtan üretilen hatalı çıktının kime ait olduğu belirsizleşir. Bu belirsizlik iç ve dış denetimlerde kritik güvenlik açığına dönüşür.

04Kurumsal Ölçekte Ne Anlama Gelir?

Bireysel kullanımda sınırlı görünen risk, kurumsal ölçeğe taşındığında katlanarak büyür.

Uyumluluk Çöküşü

ISO 27001, BDDK, SOC 2 gibi çerçeveler veri işleme faaliyetlerinin belgelenmesini ve kontrol edilmesini zorunlu kılar. Shadow AI bu belgeleme zincirini kırar ve dış denetimlerde kritik bulgulara yol açar.

Güvenlik Mimarisinin Kör Noktaları

DLP sistemleri ve CASB çözümleri, onaysız AI araçlarına yönelik veri akışlarını genellikle görünür kılmaz. Bu durum SOC’ta büyük kör noktalar oluşturur.

İş Sürekliliği Riski

Bir ekip iş süreçlerini onaysız bir AI aracına bağlamışsa ve bu araç hizmet dışı kalır ya da politikasını değiştirirse, kurum hazırlıksız yakalanır.

05Tespit Yöntemleri

Shadow AI’ı tespit etmek, çoğu kullanımın meşru HTTPS trafiği üzerinden gerçekleşmesi nedeniyle Shadow IT’den daha karmaşıktır. Ancak etkili yöntemler mevcuttur.

// Tespit Araç Seti

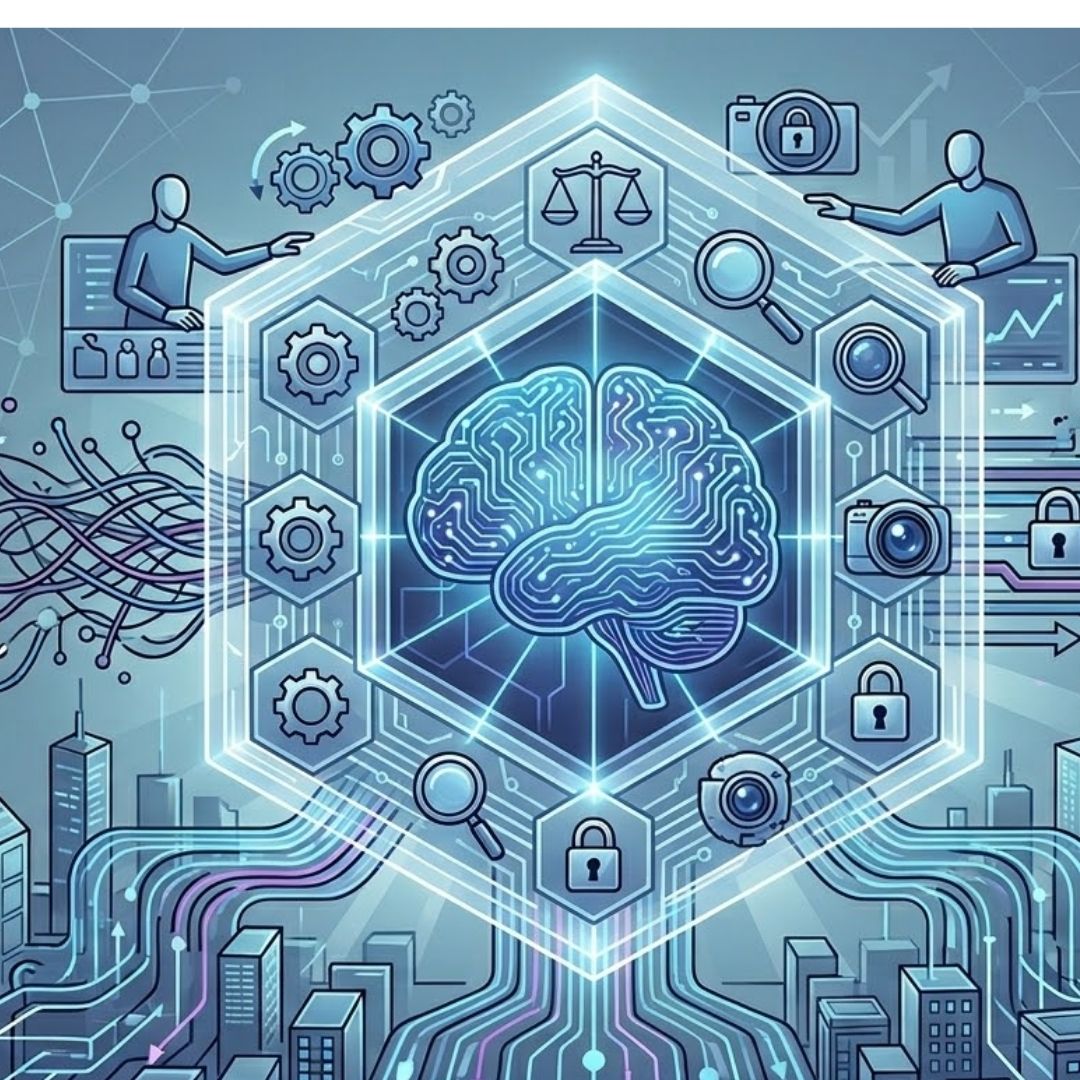

06Yönetişim Çerçevesi

Shadow AI sorununa yasak ve kısıtlama odaklı yaklaşmak tarihsel olarak başarısız olmuş bir stratejidir. Çalışanlar yine de kullanır; yalnızca daha gizli kullanır. Etkili yönetişim engellemek yerine görünür kılmak ve güvenli alternatifleri sunmak üzerine inşa edilmelidir.

// Yönetişim — 6 Sütun

SonYasak Değil, Görünürlük — Ama Artık Zorunlu

Shadow AI, kurumların yapay zekâyı nasıl benimsediğine dair gerçek bir sinyal taşır: çalışanlar bu araçları kullanmak ister, çünkü işe yarıyorlar. Problem, bu isteğin kurumsal güvenlik ve uyumluluk mekanizmalarının dışında kalmasıdır.

KVKK’nın Şubat 2026 rehberi bu tartışmayı yeni bir boyuta taşıdı. Shadow AI artık yalnızca bir güvenlik açığı değil, 6698 sayılı Kanun kapsamında hesap verilmesi gereken bir yönetim alanıdır. Denetimciler bu rehberi biliyor. Düzenleyiciler bu alana bakıyor.

Shadow AI’ı görünür kılmak hem uyumluluğun hem de güvenliğin başlangıç noktasıdır.